本站原创文章,转载请说明来自《老饼讲解-机器学习》www.bbbdata.com

线性回归模型是机器学习中最简单的模型,它用线性关系去拟合变量与因变量之间的关系

线性回归虽然简单,但包含了机器学习的精髓,学好线性回归模型,是入门机器学习的基石

本文讲解线性回归的原理,包括模型思想、模型表达式、损失函数和求解方法等

本节通过介绍线性回归的思想,进一步学习线性回归原理

线性回归-原理与思想

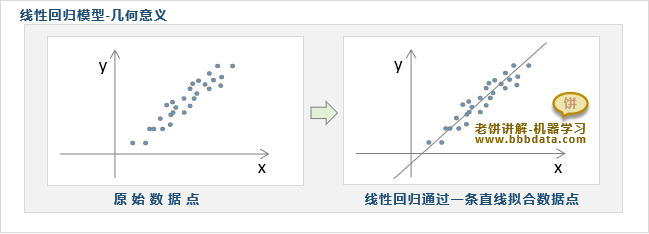

线性回归模型的思想原理是希望找到一条直线(平面或超平面)去拟合样本数据点

最佳拟合时,直线与样本的总均方误差最小

在x为一维时,y 与 x 组成二维平面时,可如下理解:

线性回归模型以一条直线拟合数据,如下:

线性回归的拟合目标是总均方误差最小,如下:

本节介绍线性回归的模型表达式与损失函数

线性回归-模型表达式与损失函数

线性回归-模型表达式

线性回归的模型表达式如下:

线性回归-损失函数

线性回归的损失函数为模型预测值与真实值的均方差,如下:

备注:上标 (i) 代表第i个样本,m为样本个数,n为变量个数

线性回归-矩阵形式

为书写方便,线性回归的模型和损失函数往往写成矩阵形式

线性回归的模型表达式矩阵形式如下:

线性回归的损失函数矩阵形式如下:

✍️说明

矩阵形式中的X是在原变量再加上一列常数1:

W也比对应地比原来的多一个,这样做的目的是把 b揉进了W里

如下所示:

本节讲解线性回归模型的系数求解方法

线性回归-模型求解

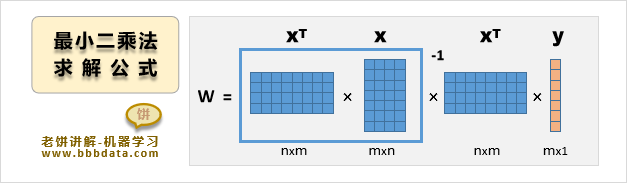

线性回归模型的求解,直接使用最小二乘法求解就可以

最小二乘法的求解公式如下:

使用该公式即可求得令线性回归损失函数L(W)取得最小值的W

关于最小二乘法的原理,可以参考《最小二乘法》

好了,以上就是线性回归的模型原理的主要内容

End