本站原创文章,转载请说明来自《老饼讲解-机器学习》www.bbbdata.com

信息熵是机器学习中一个常用的基本概念,它是信息量的延伸概念

信息熵一般用于表示事件的混沌性,在逻辑回归和决策树等模型都涉及到信息熵的相关知识

本文讲解信息熵、香农信息熵等相关概念与计算公式,以及信息熵的意义,快速了解信息熵是什么意思

本节介绍信息熵的定义和信息熵的计算公式

信息熵的定义与计算公式

信息熵通俗来说就是信息量的期望,香农信息熵则是香农信息量的期望,详细如下:

如果已知 x 有 n 种取值,且知道每种取值的概率,

则定义 x 的信息量期望为信息熵

信息熵的计算公式如下:

特别地,当h(x)取为香农信息量时,称为香农信息熵

香农信息熵公式如下:

✍️信息熵举例说明

假设已知一个人的性别为男、女的概率分别为

那么,来了一个人,

此人是男的概率为,当我们真正知道他是男的时候,带来的信息量为,

此人是女的概率为,当我们真正知道她是女的时候,带来的信息量为,

所以,期望获得的信息量为

最后,把"知道x的真实值"所获得的信息量h的期望称为x的熵

本节介绍信息熵常用的意义与作用

信息熵的意义

为什么需要把信息期望单独拎出来定义为信息熵?那是因为我们经常需要使用它

下面我们举两个例子感受一下信息量期望(信息熵)的无处不在

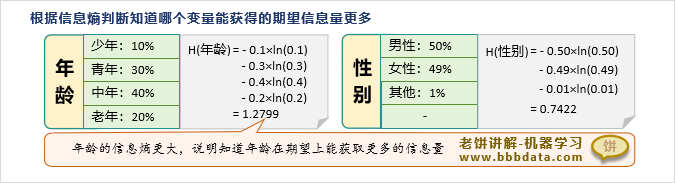

信息熵的作用1:变量的价值

如果有两个变量,我们只能知道其中一个变量的值,

那么,我们应该选择知道哪一个呢?

当然是知道哪个变量能获得的信息期望(信息熵)越大,我们就选择哪一个

这时候,我们就需要计算变量的信息期望了,也就是计算信息熵

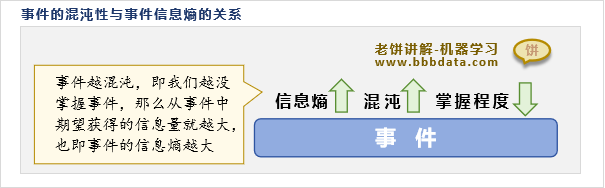

信息熵的作用2:用于评估事件的混沌程度

当我们对一个事件越不确定时,即越混沌时,

在得知该事件的确切值时期望获得的信息量就越多,

即事件越混沌,事件的信息熵就越大

因此,一般可用信息熵来评估一个事件的混沌程度,或者我们对事件的掌握程度

1. 对事件的评估

信息熵越小,代表事件越清晰,事件的信息熵越大,代表事件本身越混沌

2. 评估我们对事件的掌握程度

事件的信息熵越大,代表我们对事件的掌握程度越小

事件的信息熵越小,代表我们对事件的掌握程度越大

好了,信息量的概念与意义就写到这了~

End