本站原创文章,转载请说明来自《老饼讲解-机器学习》www.bbbdata.com

逻辑回归模型采用交叉熵损失函数来训练模型,它的目的是最小化模型的交叉熵

本文从交叉熵的角度,讲解逻辑回归的交叉熵损失函数的意义以及公式推导

通过本文可以更加具体了解在逻辑回归中,交叉熵损失函数的目的,以及它与模型的关系

本节讲解逻辑回归模型的交叉熵损失函数是如何推导出来的

逻辑回归损失函数推导-基于交叉熵

由于逻辑回归模型输出的是样本属于1类的概率

则有:

👉1. 模型评估0类的样本属于0类的概率为:

👉2. 模型评估1类的样本属于1类的概率为:

因此,基于模型的判断结果,

对于0类样本获得的信息量为:

对于1类样本获得的信息量为:

则基于模型的判断结果,在知道样本的真实类别标签时,

所获得的信息量的期望(交叉熵)为:

这就是逻辑回归的交叉熵损失函数了~

逻辑回归-模型原理-整理

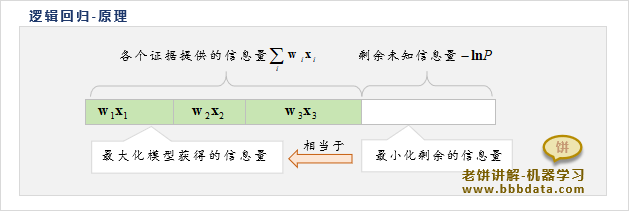

逻辑回归模型的原理就是通过一个一个的证据,

来逐步减少样本真实标签的信息量,从而增加对样本标签的认知

然后再把" 基于模型的认知下",样本标签的信息量期望(交叉熵)作为损失函数

通过最小化损失函数,来使样本的剩余信息量最小化,也就是最大化模型所获得的信息量

这样说不是太严谨的,但大概就是这么个意思~

好了,逻辑回归交叉熵损失函数的公及及推导就讲到这里了~

End