本站原创文章,转载请说明来自《老饼讲解-机器学习》www.bbbdata.com

交叉熵损失函数(Cross-Entropy Loss)是基于交叉熵的概念而设计的一种损失函数,常用于分类模型

本文讲解交叉熵损失函数的公式和推导,以及交叉熵损失函数在模型为二分类时的形式

通过本文可以快速了解交叉熵损失函数什么是,它是如何来的,以及它的公式具体意义是什么

本节讲解分类模型中的交叉熵损失函数的定义及计算公式

什么是交叉熵损失函数

交叉熵损失函数的定义

交叉熵损失函数(Cross-Entropy Loss)是一种常用于概率预测模型的损失函数

交叉熵损失函数是指,基于模型的预测概率,在知道真实标签时的交叉熵

交叉熵损失函数的定义公式如下:

其中,为第i个样本属于真实类别的预测概率,m是样本个数

交叉熵损失函数-公式解读

交叉熵是在认知概率下,得知事实时所获得的信息量期望

交叉熵损失函数则是以模型的预测概率作为基础认知,在知道真实标签时所获得的信息量期望

由于知道样本i的真实标签时,所获得的信息量为

因此,交叉熵损失函数就是所有样本在知道真实标签时所获得的信息量的均值,即期望

交叉熵越小,期望获得的信息量就越小,说明我们对本身事物越掌握,也即模型的预测概率越准确

所以交叉熵损失函数的目的,就是最小化期望信息量,也即最大化模型概率预测的准确程度

交叉熵损失函数-计算公式

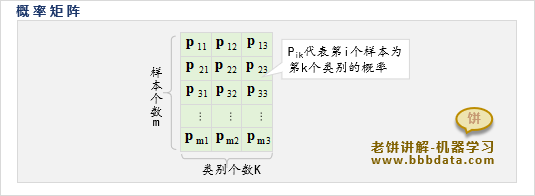

由于我们的预测结果一般是如下的概率矩阵P,其中代表第i个样本属于类别k的概率

因此,往往会将交叉熵损失函数写成如下形式:

其中, :样本个数

:类别个数

:第i个样本的真实类别

:第i个样本属于第k个类别的预测概率

它的意思就是先统计每个类别的样本在知道真实标签时获得的信息量,再对类别求和,并求均值

这是因为类别的数量一般远小于样本数据,计算时先按同一类别计算,更方便程序实现

本节讲解交叉熵损失函数在二分类时的形式,以及推导过程

交叉熵损失函数-二分类模型

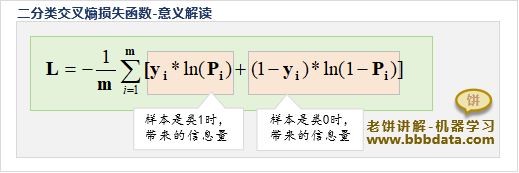

在二分类模型中,一般将类别标签记为0/1两类,此时,交叉熵损失函数形式如下

二分类模型的交叉熵损失函数:

其中,:样本个数

:第i个本样的真实类别标签

:模型判断第个i样本属于第1类的概率

二分类交叉熵损失函数的意义解读如下:

交叉熵损失函数就是希望在模型的预测下,在知道样本真实标签时信息量越小越好

交叉熵损失函数-推导过程(二分类)

在二分类模型中,一般将类别标签记为0/1两类,模型则输出样本属于1类的概率

因此,模型对0,1类样本正确预测的概率为:

1. 模型评估0类的样本属于0类的概率为:

2. 模型评估1类的样本属于1类的概率为:

则基于模型的预测,在知道样本真实标签时,所获得的信息量的期望(交叉熵)为:

上述结果就是二分类时的交叉熵损失函数表达式,在逻辑回归模型中使用的就是该函数

好了,交叉熵损失函数的公及及推导就讲到这里了~

End

评论

评论